softmax回归(线性神经网络)(PyTorch)

softmax 回归

通常,机器学习实践者用“分类”这个词来描述两个有微妙差别的问题:1.我们只对样本的“硬性”类别感兴趣,即属于哪个类别;2.我们希望得到“软性”类别,即得到属于每个类别的概率。这两者的界限往往很模糊。其中的一个原因是:即使我们只关心硬类别,我们仍然使用软类别的模型。我们从一个图像分类问题。假设每次输入是一个one-hot encoding)。读热编码是一个向量,它的分量和类别一样多。类别对应的分量设置为1,其它所有分量设置为0,在我们的例子中,标签(1,0,0)对应于猫,(0,1,0)对应于鸡,(0,0,1)对应于狗:

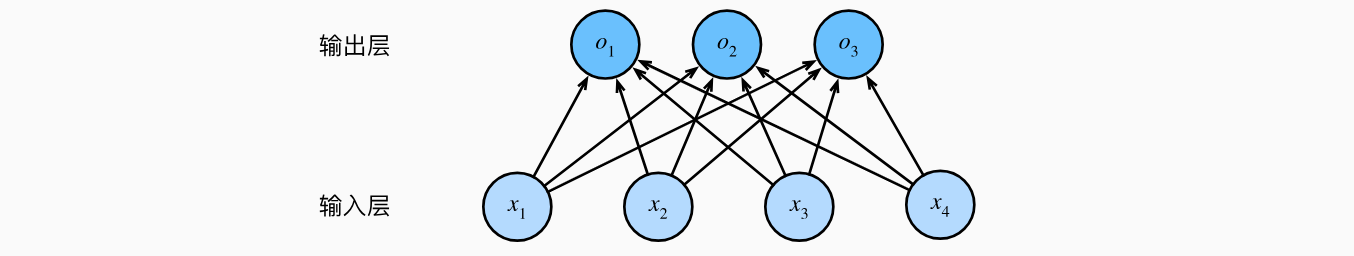

网络架构

为了估计所有可能类别的条件概率,我们需要一个有多个输出的模型,每个类别对应一个输出。为了解决线性模型的分类问题,我们需要和输出一样多的仿射函数(affine function)。每个输出对应于它自己的仿射函数。在我们的例子中,由于我们有4个特征和3个可能的输出类别,我们将需要12个标量来表示权重(带下标的3个标量来表示偏置(带下标的logit):

我们可以用神经网络图来描述这个计算过程。与线性回归一样,softmax回归也是一个单层神经网络。由于计算每个输出softmax回归的输出层也是全连接层。

为了更简洁地表达模型,我们仍然使用线性代数符号。通过向量形式表达为

全连接层的参数开销

在深度学习中,全连接层无处不在。然而,全连接层是完全连接的,可能有很多可学习的参数。具体来说,对于任何具有

softmax运算

现在我们将优化参数以最大化观测数据的概率。为了得到预测结果,我们将设置一个阈值,如选择具有最大概率的标签。我们希望模型的输出0.1、0.8和0.1,那么我们的预测类别是2,在我们的例子中代表鸡。然而我们能否将未规范化的预测1。另一方面,根据输入的不同,它们可以为负值。要将输出视为概率,我们必须保证在任何数据上的输出都是非负的且总和为1。此外,我们需要一个训练的目标函数,来激励模型精准地估计概率。例如,在分类器输出0.5的所有样本中,我们希望这些样本是刚好有一半实际上属于预测的类别。这个属性叫做校准(calibration)。

社会科学家邓肯·卢斯于1959年在选择模型(choice model)的理论基础上发明的softmax函数正是这样做的:softmax函数能够将未规范化的预测变换为非负数并且总和为1,同时让模型保持 可导的性质。为了完成这一目标,我们首先对每个未规范化的预测求幂,这样可以确保输出非负。为了确保最终输出的概率值总和为1,我们再让每个求幂后的结果除以它们的总和。如下式:

这里,对于所有的softmax运算不会改变为规范化的预测

尽管softmax是一个非线性函数,但softmax回归的输出仍然由输入特征的仿射变换决定。因此,softmax回归是一个线性模型(linear model)。

小批量样本的矢量化

为了提高计算效率并且充分利用GPU,我们通常会对小批量样本的数据执行矢量计算。假设我们读取了一个批量的样本softmax回归的矢量计算表达式为:

相对于一次处理一个样本,小批量样本的矢量化加快了softmax运算可以按行(rowwise)执行;对于

损失函数

接下来,我们需要一个损失函数来度量预测的效果。我们将使用最大似然估计,这与在线性回归中的方法相同。softmax函数给出了一个向量

根据最大似然估计,我们最大化

其中,对于任何标签

以上的损失函数,通常被称为交叉熵损失(cross-entropy loss)。由于0,因此,如果正确地预测实际标签softmax和相关的损失函数很常见,因此我们需要更好地理解它的计算方式。利用softmax的定义,我们得到:

考虑相对于任何未规范化的预测

换句话说,导数是我们softmax模型分配的概率与实际发生的情况(由独热标签向量表示)之间的差异。从这个意义上讲,这与我们在回归中看到的非常相似,其中梯度是观测值(0.1,0.2,0.7),而不是仅包含二元项的向量(0,0,1)。我们定义损失cross-entropy loss),它是分类问题最常用的损失之一。

信息论

信息论(information theory)涉及编码、解码、发送以及尽可能简洁地处理信息或数据。信息论的核心思想是量化数据中的信息内容。在信息论中,该数值被称为分布entropy)。可以通过以下方程得到:

信息论的基本定理之一指出,为了对从分布nat)对其进行编码。“纳特”相当于比特(bit),但是对数底为

压缩与预测有什么关系呢?想象一下,我们有一个要压缩的数据流。如果我们很容易预测下一个数据,那么这个数据就很容易压缩。为什么呢?,举一个极端的例子,加入数据流中的每一个数据都相同,这会是一个无聊的数据流,由于它们总是相同的,我们总是知道下一个数据是什么。所以,为了传递数据流的内容,我们不必传输任何信息。也就是说,“下一个数据是xx”这个事件毫无信息量。但是,如果我们不能完全预测每一个事件,那么我们有时可能会感到“惊异”。克劳德·香农决定用信息量

在训练softmax回归模型后,给出任何样本特征,我们可以预测每个输出类别的概率。通常我们使用预测概率最高的类别作为输出类别。如果预测与实际类别(标签)一致,则预测是正确的。在接下来的实验中,我们将使用精度(accuracy)来评估模型的性能。精度等于正确预测数与预测总数之间的比率。

总结

softmax运算获取一个向量并将其映射为概率。softmax回归适用于分类问题,它使用了softmax运算中输出类别的概率分布。交叉熵是一个衡量两个概率分布之间差异的很好的度量,它测量给定模型编码数据所需的比特数。