线性回归(线性神经网络)(PyTorch)

线性回归

回归(regression)是能为一个或多个自变量与因变量之间关系建模的一类方法。在自然科学和社会科学领域,回归经常用来表示输入和输出之间的关系。在机器学习领域中的大多数任务通常都与预测(prediction)有关。当我们向预测一个数值时,就会涉及到回归问题。常见的例子包括:预测价格(房屋、股票等)、预测住院时间(针对住院病人等)、预测需求(零售销量等)。但不是所有的预测都是回归问题。分类问题的目标是预测数据属于一组类别中的哪一个。

线性回归的基本元素

线性回归(linear regression)可以追溯到19世纪初,它在回归的各种工具中最简单且最流行。线性回归基于几个简单的假设:首先,自变量

为了解释线性回归,我们举一个实际的例子:我们希望根据房屋的面积(平方英尺)和房龄(年)来估算房屋的价格(美元)。为了开发一个能够预测房价的模型,我们需要收集一些真实的数据集。这个数据集包括了房屋的销售价格、面积和房龄。在机器学习术语中,该数据集称为训练数据集和训练集。每行数据(比如一次房屋交易相对应的数据)称为养样本,也可以称为数据点或数据样本,我们把试图预测的目标(比如预测房屋价格)称为标签(label)或目标(target)。预测所依据的自变量(面积和房龄)称为特征(feature)或协变量(covariate)。通常,我们用

线性模型

线性假设是指目标(房屋价格)可以表示为特征(面积和房龄)的加权和,如下面的式子:

对于(weight),权重决定了每个特征对我们预测值的影响,(bias)、偏移量(offset)或截距(intercept)。偏置是指当所有特征取值为0时,预测值应该为多少。既使现实生活中不会有房屋的面积为0或房龄正好为0年,我们仍然需要偏置项。如果没有偏置项,我们模型的表达能力将会受到限制。严格来说,它是输入特征的一个仿射变换(affine transformation)。仿射变换的特点是通过加权和对特征进行线性变换(linear transformation),并通过偏置项来进行平移(translation)。给定一个数据集。我们的目标是寻找模型的权重

将所有特征放到向量

向量

这个过程中的求和将使用广播机制。给定训练数据特征model parameters)

损失函数

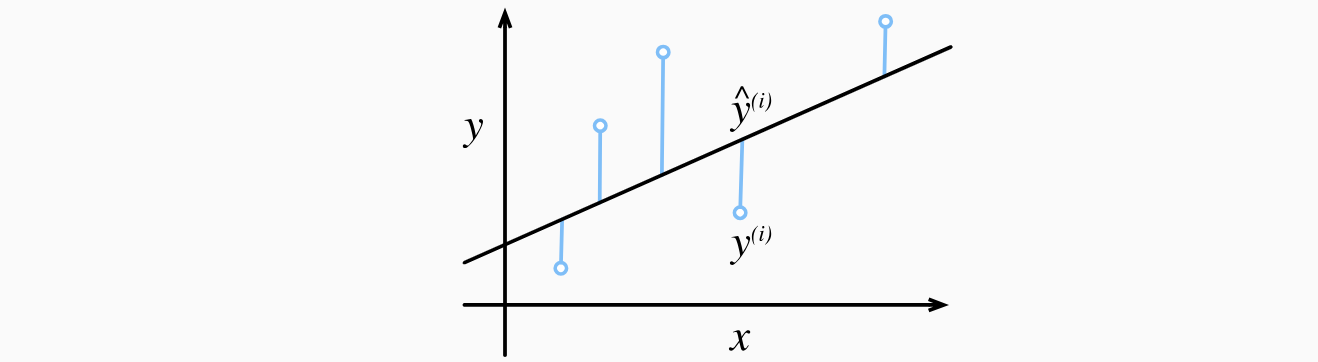

在我们开始考虑如何用模型拟合(fit)数据之前,我们需要确定一个拟合程度的度量。损失函数(loss function)能够量化目标的实际值与预测值之间的差距。通常我们会选择非负数作为损失,且数值越小表示损失越小,完美预测时的损失为0。回归问题中最常用的损失函数是平方误差函数。当样本

常数

由于平方误差函数中的二次方项,估计值

在训练模型时,我们希望寻找一组参数

解析解

线性回归刚好是一个很简单的优化问题。线性回归的解可以用一个公式简单地表达出来,这类解叫做解析解(analytical solution)。首先我们将偏置b合并到参数

像线性回归这样的简单问题存在解析解,但并不是所有的问题都存在解析解。解析解可以很好的进行数学分析,但解析解对问题的限制很严格,导致它无法广泛的应用在深度学习当中。

随机梯度下降

即使在我们无法得到解析解的情况下,我们仍然可以有效地训练模型。在许多任务上,那些难以优化的模型效果要更好。因此,弄清楚如何训练难以优化的模型是非常重要的。我们用到一种梯度下降(gradient descent)的方法,这种方法几乎可以优化所有深度学习模型。它通过不断地在损失函数递减的方向上更新参数来降低误差。梯度下降最简单的用法是计算损失函数(数据集中所有样本的损失均值)关于模型参数的导数(在这里也可以称为梯度)。但实际中的执行可能会非常慢:因为在每一次更新参数之前,我们必须遍历整个数据集。因此,我们通常会在每次需要计算更新的时候随机抽取一小批样本,这种变体叫做“小批量随机梯度下降”(minibatch stochastic gradient descent)。在每次迭代中,我们首先随机抽样一个小批量

总结一下,算法步骤如下:(1)初始化模型参数的值,如随机初始化;(2)从数据集随机抽取小批量样本且在负梯度的方向上更新参数,并不断迭代这一步骤。对于平方损失和仿射变换,我们可以明确地写成如下形式:

公式中batch size)。learning rate)。批量大小和学习率的值通常是手动预先设定的,而不是通过模型训练得到的。这些可以调整但不在训练过程中更新的参数称为超参数(hyperparameter)。调参(hyperparameter tuning)是选择超参数的过程。超参数通常是我们根据训练迭代结果来调整的,而迭代训练结果是在独立的验证数据集(validation dataset)上评估得到的。在训练了若干迭代次数之后(或者直到满足某些其他停止条件后),我们记录下模型参数的估计值,表示为generalization)。

用模型进行预测

给定已学习的线性回归模型prediction)或推断(inference)。本书将尝试坚持使用预测这个词。虽然推断这个词已经成为深度学习的标准术语,但其实推断这个词有些用词不当。在统计学中,推断更多地表示基于数据集估计参数。当深度学习从业者与统计学家交谈时,术语的误用经常导致一些误解。

矢量化加速

在训练我们的模型时,我们经常希望能够同时处理整个小批量的样本。为了实现这一点,需要我们对计算进行矢量化,从而利用线性代数库,而不是在Python中编写开销高昂的for循环。

1 | import math |

正态分布与平方损失

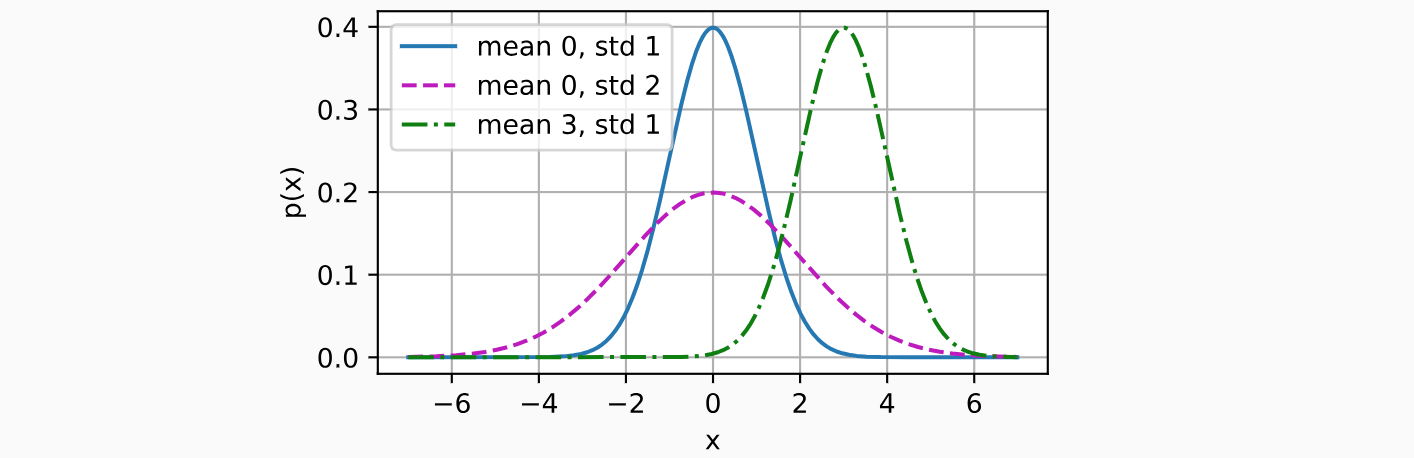

我们通过对噪声分布的假设来解读平方损失目标函数。正态分布和线性回归之间的关系很密切。正态分布(normal distribution),也称为高斯分布(Gaussian distribution),最早由德国数学家高斯(Gauss)应用于天文学研究。简单来说,若随机变量

下面我们定义一个Python函数来计算正态分布。

1 | def normal(x, mu, sigma): |

就像我们所看到的,改变均值会产生沿

其中,likelihood):

现在,根据极大似然估计法,参数

根据极大似然估计法选择的估计量称为极大似然估计量。虽然使许多指数函数的乘积最大化看起来很困难,但是我们可以在不改变目标的前提下,通过最大化似然对数来简化。由于历史原因,优化通常是说最小化而不是最大化。我们可以改为最小化负对数似然

从线性回归到深度网络

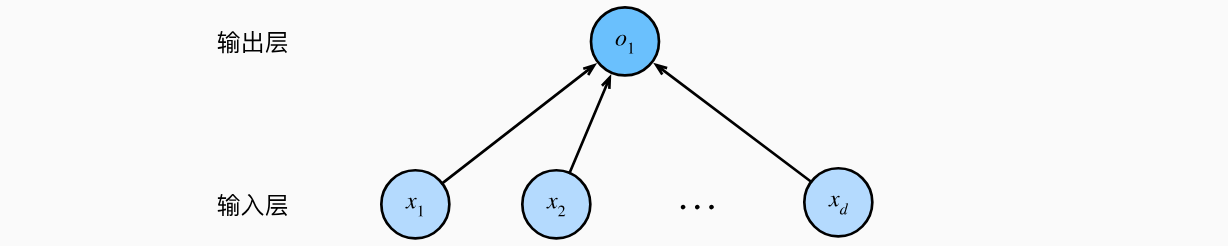

到目前为止,我们只谈论了线性模型。尽管神经网络涵盖了更多更为丰富的模型,我们依然可以用描述神经网络的方式来描述线性模型,从而把线性模型看作一个神经网络。首先,我们用“层”符号来重写这个模型。深度学习从业者喜欢绘制图表来可视化模型中正在发生的事情。在下图中,我们将线性回归模型描述为一个神经网络。需要注意的是,该图只显示连接模式,即只显示每个输入如何连接到输出,隐去了权重和偏置的值。

在上图所示的神经网络中,输入为feature dimensionality)为1。需要注意的是,输入值都是已经给定的,并且只有一个计算神经元。由于模型重点在发生计算的地方,所以通常我们在计算层数时不考虑输入层。也就是说,在上图中神经网络的层数为1。我们可以将线性回归模型视为仅由单个人工神经元组成的神经网络,或称为单层神经网络。对于线性回归,每个输入都与每个输出(在本例中只有一个输出)相连,我们将这种变换(上图中的输出层)称为全连接层(fully-connected layer)或称为稠密层(dense layer)。

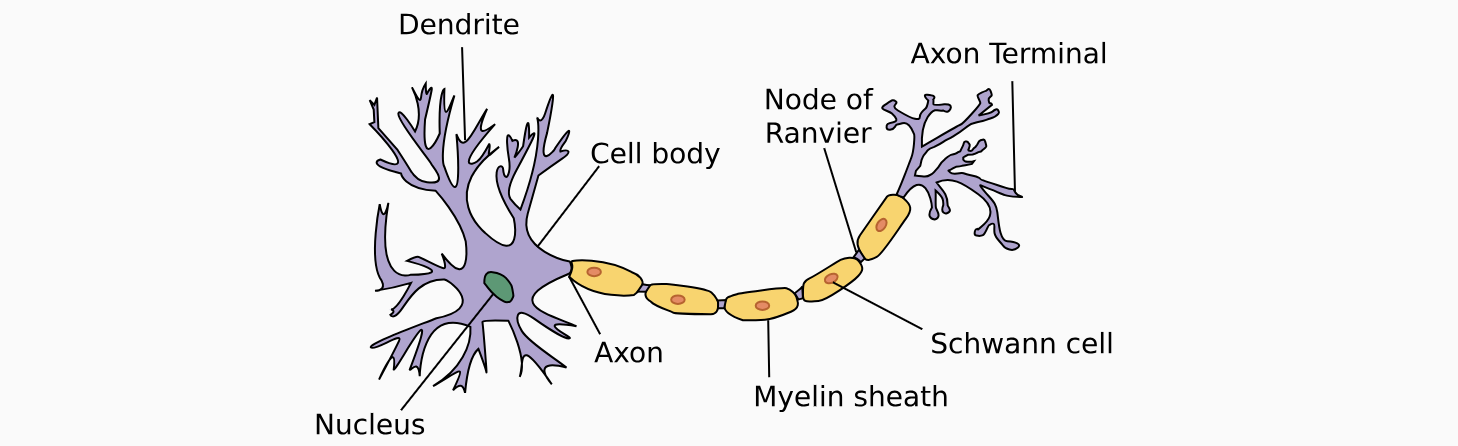

线性回归发明的时间(1795年)早于计算神经科学,所以将线性回归描述为神经网络似乎不合适。当控制学家、神经生物学家沃伦·麦库洛奇和沃尔特·皮茨开始开发人工神经元模型时,他们为什么将线性模型作为一个起点呢?我们来看下图:这是一张由树突(dendrites,输入终端)、细胞核(nucleus,CPU)组成的生物神经元图片。轴突(axon,输出线)和轴突端子(axon terminal,输出端子)通过突触(synapse)与其他神经元连接。

树突中接收到来自其他神经元(或视网膜等环境传感器)的信息

当然,许多这样的单元可以通过正确连接和正确的学习算法拼凑在一起,从而产生的行为会比单独一个神经元所产生的行为更有趣、更复杂,这种想法归功于我们对真实生物神经系统的研究。当今大多数深度学习的研究几乎没有直接从神经科学中获得灵感。我们援引斯图尔特·罗素和彼得·诺维格在他们的经典人工智能教科书Artificial Intelligence:A Modern Approach (Russell and Norvig, 2016) 中所说的:虽然飞机可能受到鸟类的启发,但几个世纪以来,鸟类学并不是航空创新的主要驱动力。同样地,如今在深度学习中的灵感同样或更多地来自数学、统计学和计算机科学。

总结

机器学习模型中的关键要素是训练数据、损失函数、优化算法,还有模型本身。矢量化使数学表达上更简洁,同时运行的更快。最小化目标函数和执行极大似然估计等价。线性回归模型也是一个简单的神经网络。